Mit der rasanten Entwicklung und zunehmenden Implementierung von KI-Technologien in verschiedensten Lebensbereichen gewinnen ethische Fragestellungen immer mehr an Bedeutung. Dieser Artikel beleuchtet die wichtigsten ethischen Herausforderungen im Bereich der KI und diskutiert mögliche Lösungsansätze.

Die grundlegenden ethischen Herausforderungen

Künstliche Intelligenz stellt uns vor einzigartige ethische Dilemmata, die traditionelle ethische Rahmenwerke auf die Probe stellen. Die Hauptprobleme lassen sich in folgende Kategorien einteilen:

- Transparenz und Erklärbarkeit von KI-Entscheidungen

- Fairness und Voreingenommenheit in KI-Systemen

- Datenschutz und Privatsphäre

- Verantwortlichkeit bei KI-generierten Schäden

- Autonomie und menschliche Kontrolle

Die Black-Box-Problematik

Ein grundlegendes Problem moderner KI-Systeme, insbesondere im Bereich des Deep Learning, ist ihre mangelnde Transparenz. Oft funktionieren diese Systeme als "Black Boxes", deren Entscheidungswege selbst für ihre Entwickler nicht vollständig nachvollziehbar sind.

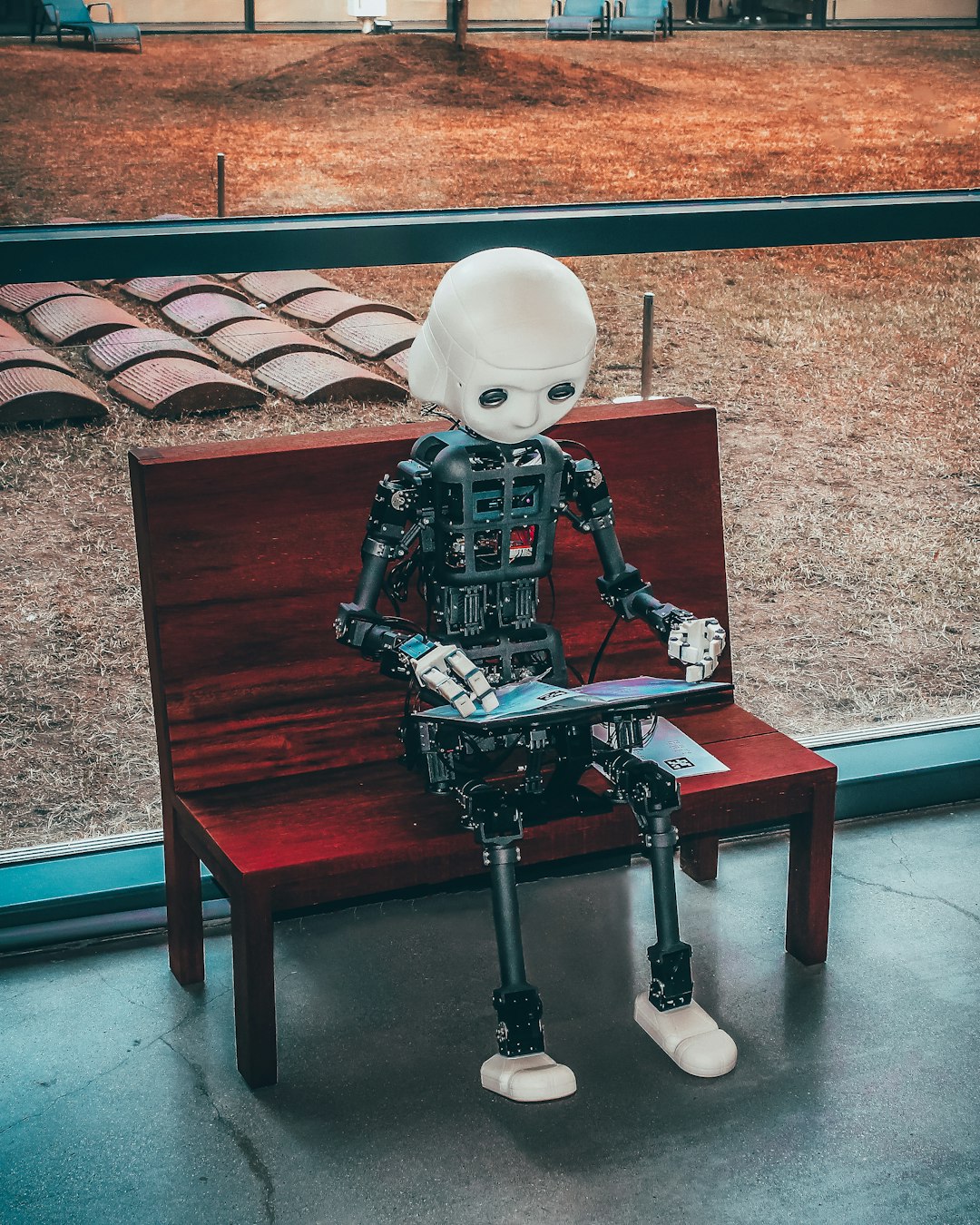

Visualisierung der "Black-Box"-Problematik bei komplexen neuronalen Netzen

Diese Undurchsichtigkeit wird besonders problematisch, wenn KI-Systeme in kritischen Bereichen eingesetzt werden, etwa bei:

- Medizinischen Diagnosen

- Kreditwürdigkeitsprüfungen

- Strafrechtlichen Risikobewertungen

- Einstellungsentscheidungen

In diesen Kontexten ist es essentiell, dass Entscheidungen nachvollziehbar und begründbar sind – eine Anforderung, die viele aktuelle KI-Systeme nicht erfüllen können.

Bias und Diskriminierung

KI-Systeme werden mit Daten trainiert, die gesellschaftliche Vorurteile und historische Ungerechtigkeiten widerspiegeln können. Ohne geeignete Gegenmaßnahmen können diese Systeme bestehende Diskriminierungen verstärken oder sogar neue Formen der Benachteiligung schaffen.

"KI-Systeme sind nur so fair und unvoreingenommen wie die Daten, mit denen wir sie trainieren, und die Menschen, die sie entwickeln."

Beispiele für problematische Verzerrungen in KI-Systemen finden sich in verschiedenen Anwendungsbereichen:

- Gesichtserkennung mit schlechterer Erkennungsrate bei nicht-weißen Gesichtern

- Spracherkennungssysteme, die bestimmte Akzente oder Dialekte nicht korrekt verarbeiten

- Rekrutierungs-Algorithmen, die Frauen benachteiligen

- Kreditvergabe-Systeme, die bestimmte soziale Gruppen systematisch diskriminieren

Datenschutz und Privatsphäre

KI-Systeme benötigen für ihr Training und ihre Funktion oft große Mengen persönlicher Daten. Dies wirft Fragen zum Datenschutz und zur informationellen Selbstbestimmung auf.

Besonders heikel sind folgende Aspekte:

- Sammlung und Verarbeitung sensibler persönlicher Daten

- Potenzial für Überwachung und Kontrolle

- Profilerstellung und Verhaltensvorhersage

- Langfristige Speicherung persönlicher Informationen

- Möglichkeit der Re-Identifizierung anonymisierter Daten

Verantwortung und Haftung

Wenn KI-Systeme Entscheidungen treffen oder Handlungen ausführen, die zu Schäden führen, stellt sich die Frage nach der Verantwortung und Haftung. Wer trägt die Verantwortung: der Entwickler, der Betreiber, der Nutzer oder das System selbst?

Diese Frage wird besonders relevant bei autonomen Systemen wie selbstfahrenden Autos oder medizinischen Diagnose-Tools.

Lösungsansätze und Prinzipien für eine ethische KI

Um den genannten Herausforderungen zu begegnen, haben verschiedene Organisationen und Forschungsgruppen ethische Richtlinien und Prinzipien für die KI-Entwicklung vorgeschlagen. Zu den wichtigsten Ansätzen gehören:

1. Transparenz und Erklärbarkeit

- Entwicklung von "Explainable AI" (XAI) – Technologien, die KI-Entscheidungen nachvollziehbar machen

- Dokumentation von Trainingsdaten und Algorithmen

- Offenlegung der Grenzen und Unsicherheiten von KI-Systemen

2. Fairness und Nicht-Diskriminierung

- Prüfung und Bereinigung von Trainingsdaten auf Verzerrungen

- Regelmäßige Audits von KI-Systemen auf diskriminierende Muster

- Diversität in KI-Entwicklungsteams fördern

- Entwicklung technischer Methoden zur Erkennung und Korrektur von Bias

3. Datenschutz und Privatsphäre

- Implementierung von Privacy-by-Design-Prinzipien

- Minimierung der Datensammlung auf das Notwendige

- Anonymisierung und Verschlüsselung sensibler Daten

- Entwicklung datenschutzfreundlicher KI-Technologien wie Federated Learning

4. Verantwortung und Rechenschaftspflicht

- Klare Zuordnung von Verantwortlichkeiten

- Haftungsregelungen für KI-verursachte Schäden

- Einrichtung unabhängiger Aufsichtsgremien

- Regelmäßige ethische Folgenabschätzungen

5. Menschliche Autonomie und Kontrolle

- Menschen sollten letztendliche Entscheidungsgewalt behalten

- Möglichkeit, KI-Entscheidungen zu überstimmen

- Vermeidung übermäßiger Abhängigkeit von KI-Systemen

- Sicherstellung, dass KI menschliche Fähigkeiten erweitert, statt sie zu ersetzen

Internationale Initiativen und Regulierung

Weltweit arbeiten verschiedene Organisationen an ethischen Rahmenwerken und Regulierungsansätzen für KI:

- Die Europäische Union entwickelt mit dem "AI Act" den weltweit ersten umfassenden Rechtsrahmen für KI

- Die OECD hat Prinzipien für vertrauenswürdige KI veröffentlicht

- Der IEEE arbeitet an technischen Standards für ethische KI

- Die UNESCO hat eine Empfehlung zur Ethik Künstlicher Intelligenz verabschiedet

Fazit

Die ethische Gestaltung von KI-Technologien ist eine komplexe, aber notwendige Aufgabe. Sie erfordert nicht nur technische Lösungen, sondern auch gesellschaftliche Diskussionen, rechtliche Rahmenbedingungen und kontinuierliche Reflexion über die Werte, die wir in unsere technologischen Systeme einbetten wollen.

Dabei ist es wichtig, einen ausgewogenen Ansatz zu verfolgen, der Innovation ermöglicht, aber gleichzeitig grundlegende ethische Prinzipien und Menschenrechte schützt. Nur so können wir sicherstellen, dass KI-Technologien zum Wohle aller Menschen entwickelt und eingesetzt werden.

Kommentare (2)

Andreas Bauer

11. Oktober 2023, 16:20Ein sehr durchdachter Artikel, der die wichtigsten ethischen Probleme gut zusammenfasst. Ich denke, besonders die Frage der Verantwortung wird uns in den kommenden Jahren noch intensiv beschäftigen.

Claudia Winter

12. Oktober 2023, 10:05Ich arbeite selbst in der KI-Entwicklung und kann bestätigen, wie wichtig diese ethischen Überlegungen in der Praxis sind. Wir brauchen definitiv mehr verbindliche Standards und nicht nur freiwillige Selbstverpflichtungen der Unternehmen.

Hinterlassen Sie einen Kommentar